Rubén Alba Ruiz

Técnico de Gestión Documental, Archivo y Biblioteca. Hospital Universitario Virgen de las Nieves (Granada)

Aplicaciones de Inteligencia Artificial utilizadas en la investigación en salud

Introducción

La investigación en salud es un proceso riguroso y sistemático que requiere no solo un alto nivel de especialización, sino también herramientas que optimicen el tiempo y mejoren la calidad de los resultados. En este contexto, la inteligencia artificial (IA) ha emergido como una tecnología disruptiva con potencial para transformar profundamente todas las etapas del ciclo investigador, desde la formulación de preguntas hasta la publicación de resultados (1,2). Herramientas como ChatGPT, Gemini, Claude o Perplexity (por mencionar algunas) han alcanzado una adopción sin precedentes, facilitando tareas, búsquedas bibliográficas, análisis de datos, redacción científica y traducción técnica, entre otras (3,4,5).

El auge de los sistemas generativos de lenguaje natural ha supuesto una revolución en el ámbito científico, pero también ha abierto un debate sobre su uso responsable, la calidad y veracidad de los contenidos generados, y su impacto en las competencias del personal investigador (6). El caso paradigmático de ChatGPT, que alcanzó los 100 millones de usuarios en apenas dos meses desde su lanzamiento, ha servido como catalizador para promover la alfabetización tecnológica y la reflexión ética en entornos clínicos y académicos (7).

Desde el Hospital Universitario Virgen de las Nieves, se han impulsado acciones formativas dirigidas al personal del Sistema Sanitario Público de Andalucía (SSPA), centradas en el análisis y uso práctico de estas herramientas. Esta experiencia ha evidenciado una notable receptividad por parte de los profesionales, así como una demanda creciente de orientación para integrar la IA en la investigación clínica y traslacional.

Asimismo, el proyecto ChatGPT Impact ha monitorizado la huella mediática y académica del fenómeno, recopilando más de 21.000 noticias, 6 millones de tuits y más de 120.000 publicaciones en redes sociales en sus primeros meses de vida. Este volumen de atención refleja un interés social y científico sin precedentes, que ha motivado también publicaciones académicas, contribuciones en congresos y análisis de impacto desde disciplinas como la documentación, la medicina o el periodismo científico (8).

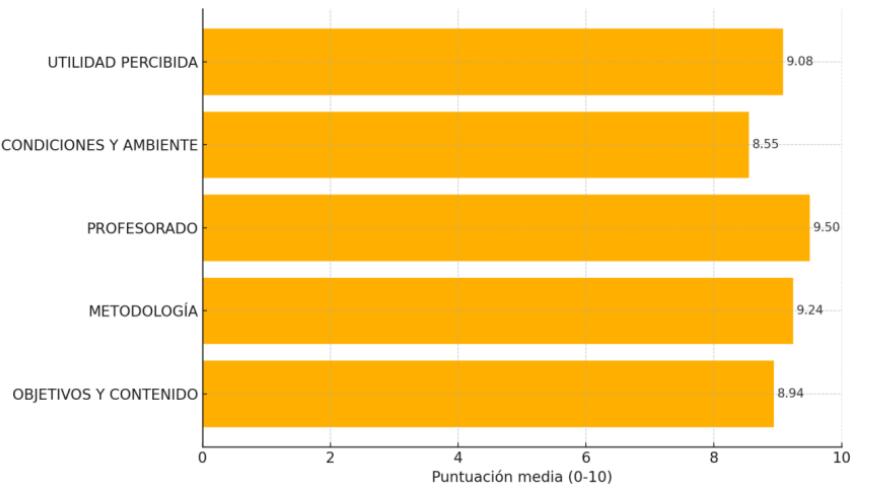

Estas dinámicas han tenido un eco directo en la práctica hospitalaria. Las acciones formativas llevadas a cabo en distintos servicios clínicos y en plataformas como GESFORMA-SAS han sido evaluadas con elevadas puntuaciones de satisfacción por parte de los profesionales sanitarios, destacando especialmente la utilidad percibida, la claridad metodológica y la aplicabilidad inmediata de los contenidos (ver gráfico). Este interés creciente refuerza la necesidad de dotar a los investigadores de herramientas accesibles y criterios sólidos para integrar estas tecnologías en su práctica científica.

Gráfico. Evaluación de la calidad percibida en las sesiones de formación

Gráfico generado con ChatGPT pero con datos reales

Gráfico generado con ChatGPT pero con datos reales

El objetivo de este artículo es describir las principales aplicaciones actuales de herramientas de inteligencia artificial en la investigación en salud, a partir de experiencias formativas e institucionales en el entorno hospitalario, y reflexionar sobre su potencial, limitaciones y desafíos éticos. Aunque estas tecnologías tienen un carácter transversal y están transformando múltiples disciplinas —desde la educación hasta las humanidades digitales, pasando por el derecho o las ciencias sociales—, este trabajo se centra en su aplicabilidad concreta en el ámbito biomédico, donde su adopción plantea oportunidades prometedoras, pero también retos específicos.

Metodología

Este artículo adopta una metodología descriptiva y experiencial basada en la práctica profesional en el ámbito hospitalario y la formación continua del personal investigador en el uso de herramientas de inteligencia artificial (IA) aplicadas a la investigación en salud. La selección de herramientas y casos se ha guiado por criterios de utilidad, aplicabilidad práctica en entornos clínicos y potencial para integrarse en los flujos de trabajo habituales de investigadores y profesionales sanitarios.

Además del criterio de utilidad y aplicabilidad clínica, se ha considerado una clasificación funcional de las herramientas basada en casos de uso comunes en investigación, como:

- Creación de contenidos (generación de textos, preguntas de investigación o resúmenes),

- Resumen automático (síntesis de documentos o artículos científicos),

- Clasificación (agrupación temática, análisis cualitativo o etiquetado de datos),

- Extracción de información (datos clave de estudios, variables de interés o resultados cuantitativos),

- Traducción técnica (adaptación multilingüe de textos científicos),

- Edición y corrección (mejora del estilo académico o revisión gramatical), y resolución de problemas (cálculos, diseño de estrategias de búsqueda, interpretación de resultados, entre otros).

Dado el vertiginoso crecimiento del ecosistema de herramientas basadas en IA —con un promedio estimado de entre 50 y 60 nuevas aplicaciones lanzadas mensualmente desde 2015, según la plataforma There’s an AI for That (https://theresanaiforthat.com/timeline/), donde identifican 34956 herramientas de IA para 13637 tareas y clasificados en 4991 empleos (actualizado 06/05/2025)—, se ha considerado esencial aplicar una estrategia de cribado basada en fuentes fiables y directorios especializados. Para ello, se han monitorizado recursos como Aifindy, Futurepedia, Futuretools, ToolifyAI, Aplicaciones.ai, AllThingsAI, AiToolHunt y SERP AI, dando especial seguimiento a ToolifyAI por su eficaz sistema de categorización y usabilidad, y a There’s an AI for That como referente de seguimiento longitudinal del mercado de aplicaciones.

Complementariamente, se han considerado las dinámicas de descubrimiento de nuevas soluciones a través de redes sociales académicas. Se ha hecho seguimiento de cuentas de especialistas en IA y ciencia abierta en plataformas como X (Twitter), así como de proyectos como InfluScience o Founderz (9,10).

La validación práctica de estas herramientas se ha realizado en el marco de sesiones formativas desarrolladas en distintos servicios del Hospital Universitario Virgen de las Nieves y en cursos virtuales coordinados desde GESFORMA-SAS. Se ha evaluado su aplicabilidad mediante ejercicios con investigadores clínicos reales, adaptando los contenidos a las necesidades detectadas en el uso cotidiano de tecnologías en investigación biomédica.

Resultados

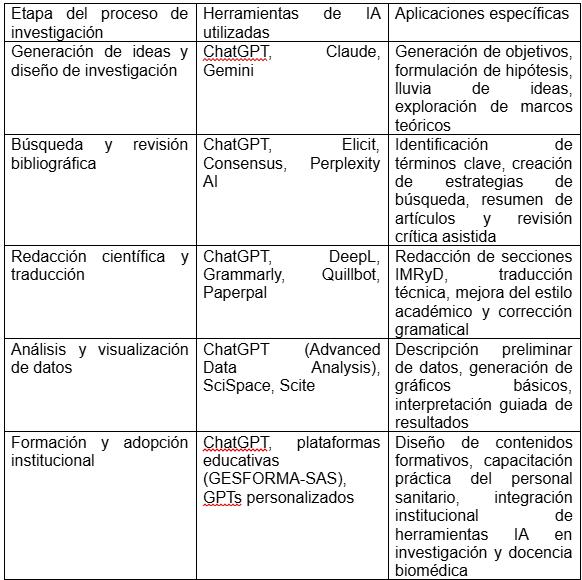

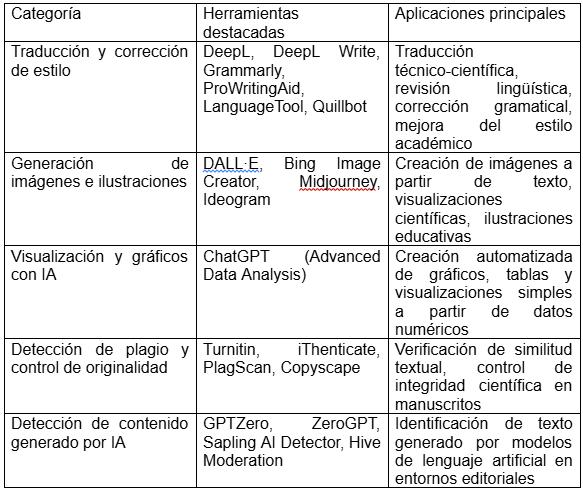

El análisis de herramientas de inteligencia artificial realizado en este trabajo se ha centrado en aquellas que presentan mayor aplicabilidad en entornos de investigación sanitaria, especialmente desde la perspectiva funcional y práctica de los profesionales clínicos. Para ello, se ha combinado una clasificación por fases del proceso investigador con una aproximación transversal por casos de uso, que permite comprender con mayor precisión para qué tareas específicas puede resultar útil cada herramienta (ver tabla 1 y 2).

1. Generación de ideas y diseño de investigación

En las fases iniciales, ChatGPT y otros modelos conversacionales como Claude o Gemini han mostrado gran utilidad en la formulación de preguntas de investigación, la exploración de objetivos y la identificación de enfoques metodológicos. Estas herramientas permiten desarrollar ideas a partir de una temática general, simular brainstorming guiados o incluso proponer estructuras para protocolos y proyectos.

Caso de uso: Problem-solving → planteamiento de hipótesis, sugerencias metodológicas, enfoques de análisis.

2. Búsqueda y revisión bibliográfica

Aunque no sustituyen a las bases de datos tradicionales ni a los profesionales de la información, herramientas como Elicit, Consensus, Scite o Perplexity AI permiten acelerar la identificación de literatura científica relevante, generar preguntas orientadas a la evidencia y resumir contenidos clave. ChatGPT, bien orientado mediante prompts específicos, puede ayudar a identificar términos clave y diseñar estrategias de búsqueda inicial.

Casos de uso: Summarization y Extraction → síntesis de artículos, extracción de variables, revisión de antecedentes.

3. Redacción científica y corrección de estilo

Una de las aplicaciones más extendidas es la ayuda en la redacción de textos académicos, incluso para el proceso de traducción. ChatGPT, Quillbot, Paperpal, Grammarly o DeepL Write permiten generar borradores, mejorar el estilo formal, corregir gramática y traducir textos técnicos con alta calidad. En entornos multilingües, suponen un recurso muy valorado para preparar manuscritos destinados a revistas internacionales.

Casos de uso: Content creation, Editing y Translation → redacción IMRyD, revisión de estilo académico, traducción técnica.

4. Análisis y visualización de datos

Herramientas como ChatGPT con Advanced Data Analysis (antiguo Code Interpreter), SciSpace permiten realizar tareas básicas de importación, limpieza, interpretación (código en específico para entenderlo en R o Python, por ejemplo) y visualización de datos. Aunque no sustituyen software estadístico especializado, son útiles en fases exploratorias o para investigadores con menos formación en análisis cuantitativo. ChatGPT también nos podría ayudar en algunas fases de la investigación cualitativa. Existen diferentes GPT`s que proporcionan asistencia experta en el análisis de datos, incluyendo el manejo de datos, estadísticas descriptivas, análisis inferenciales y técnicas de análisis exploratorio.

Casos de uso: Classification y Extraction → agrupación de datos, interpretación básica de resultados, generación de gráficos.

5. Producción de recursos visuales y didácticos

La generación de materiales gráficos, infografías o ilustraciones puede abordarse con herramientas como DALL·E, Midjourney, Ideogram o Bing Image Creator, útiles tanto para publicaciones como para sesiones docentes o divulgación. Su uso también ha sido explorado en la elaboración de contenidos educativos para formación interna.

Casos de uso: Content creation → visualización de conceptos, diseño de materiales de formación, imágenes de portada.

6. Control de calidad, ética y originalidad

Para garantizar la integridad científica, se han identificado soluciones específicas de detección de plagio (Turnitin, iThenticate, PlagScan) y de análisis de originalidad de contenido generado por IA (GPTZero, ZeroGPT, Sapling AI Detector). Estas herramientas son especialmente relevantes en contextos de evaluación académica o procesos de revisión editorial.

Casos de uso: Classification y Extraction → identificación de similitudes textuales, análisis de autenticidad.

7. Formación e implementación institucional

Las sesiones formativas desarrolladas en el Hospital Universitario Virgen de las Nieves y en el marco de GESFORMA-SAS han mostrado una alta receptividad por parte de los profesionales sanitarios. Las evaluaciones de satisfacción reflejan puntuaciones medias superiores a 9/10, especialmente en aspectos como utilidad percibida y claridad metodológica. ChatGPT ha sido una de las herramientas mejor valoradas por su accesibilidad, capacidad de adaptación y transversalidad.

8. Especialización y personalización de herramientas IA en investigación y práctica clínica

Uno de los desarrollos más relevantes en el uso avanzado de inteligencia artificial en entornos sanitarios es la posibilidad de crear herramientas personalizadas adaptadas a necesidades concretas. En este sentido, el ecosistema de GPTs personalizados de ChatGPT permite a profesionales, docentes e investigadores diseñar asistentes específicos para tareas muy concretas, como formular hipótesis, analizar artículos, generar rúbricas de evaluación o traducir terminología biomédica.

Investigadores como Ernesto Barrera o Ramón Besonías han desarrollado y compartido públicamente GPTs orientados a la educación, la divulgación científica o el asesoramiento académico, que demuestran la capacidad de adaptación y especialización de estas herramientas sin necesidad de conocimientos avanzados de programación.

Además, se están desarrollando soluciones específicas para especialidades médicas. Entre las más destacadas:

- OpenEvidence, una herramienta de apoyo a la toma de decisiones clínicas con base en la evidencia, que integra contenidos del NEJM Group (New England Journal of Medicine) y fundamenta sus respuestas en artículos validados y actualizados.

- DXGPT, desarrollado por el Servicio Madrileño de Salud (SERMAS), pionero a nivel mundial en la aplicación de IA generativa para el diagnóstico diferencial de enfermedades raras. Esta herramienta se alimenta de datos clínicos reales y se integra en el entorno hospitalario como apoyo a la decisión clínica.

Asimismo, diversos hospitales y servicios sanitarios han comenzado a experimentar con la creación de sus propios GPTs sanitarios, tanto para uso interno como en contextos de formación o gestión del conocimiento. Estas soluciones representan una nueva vía de transferencia del conocimiento clínico y científico mediante IA, abriendo la puerta a una personalización real que responde a las particularidades de cada centro, especialidad o línea de investigación.

Casos de uso: Problem-solving, Classification y Content creation → generación de contenido experto, recomendaciones clínicas basadas en evidencia, diseño de asistentes de investigación.

Discusión y Conclusiones

La irrupción de la inteligencia artificial generativa en la investigación biomédica ha supuesto un punto de inflexión que va más allá de la mera incorporación tecnológica (11). Como hemos evidenciado a lo largo de este artículo, estas herramientas permiten acompañar al investigador en prácticamente todas las fases del proceso científico, desde la formulación de la pregunta hasta la redacción y diseminación de los resultados.

Sin embargo, entre la enorme oferta de recursos existentes —miles de herramientas categorizadas en plataformas como There’s an AI for That, Toolify, Futurepedia o Aplicaciones.ai—, ChatGPT se ha consolidado como la más versátil y utilizada, hasta el punto de poder considerarse una navaja suiza digital para el investigador. Tal como sintetizaba la propia presentación del curso impartido en el SSPA: “Miles de herramientas… pero como ChatGPT ninguna”.

Y no es para menos. ChatGPT no solo permite redactar, traducir, resumir o buscar bibliografía; también genera código, crea gráficos, formula hipótesis, diseña rúbricas de evaluación o redacta protocolos. Su ecosistema ha evolucionado además hacia entornos personalizables mediante los GPTs, versiones ajustadas a necesidades concretas. En este sentido, la máxima clásica de Marcial —“Quidquid fama canit, praestat harena tibi”—(12), puede reinterpretarse hoy como “todo lo que se te ocurra, si lo sabes pedir, ChatGPT te lo puede ofrecer”.

Además, el uso adecuado de estas tecnologías no debe entenderse como una sustitución del trabajo investigador, sino como un recurso de apoyo que optimiza procesos, reduce tareas repetitivas y mejora la productividad. En contextos clínicos con limitaciones de tiempo y recursos, este tipo de herramientas permiten liberar carga cognitiva, mejorar la presentación de resultados y dedicar más energía a la interpretación crítica y la toma de decisiones informadas.

No obstante, su uso entraña riesgos importantes. Las IA generativas como ChatGPT no entienden el contenido que producen, por lo que pueden incurrir en alucinaciones o confabulaciones: generar respuestas aparentemente verosímiles pero incorrectas o inventadas. A esto se suma el riesgo de producir sesgos presentes en los datos con los que han sido entrenadas, lo que puede afectar a temas tan sensibles como género, raza, patologías poco prevalentes o contextos socioculturales específicos (13).

Por otro lado, cuando se utilizan de forma acrítica, estas herramientas corren el riesgo de convertirse en un simple “copia y pega” automatizado. Delegar completamente la redacción de un artículo, la búsqueda de información o la interpretación de datos en una IA sin supervisión humana atenta degrada la calidad científica y perpetúa errores. La tecnología es una ayuda, no un atajo. La clave está en el uso estratégico, combinado con el juicio experto, la validación crítica y la autoría responsable.

Aunque OpenAI ha liderado esta revolución, no es la única. Se han sumado otras herramientas conversacionales como Claude, Gemini, Mistral, Qwant, DeepSeek o Perplexity, y prestigiosas editoriales como Elsevier, Springer Nature o Clarivate (Web of Science) ya están incorporando modelos de IA en sus procesos editoriales y de recomendación. Cabe destacar que casi todas estas herramientas, en sus múltiples variantes, cuentan con versiones gratuitas pero también con funcionalidades avanzadas bajo suscripción o pago por uso (14).

A pesar de este panorama prometedor, los desafíos éticos, metodológicos y jurídicos son reales. La protección de datos personales, el uso transparente de estas tecnologías, la atribución de autoría y la necesidad de formación crítica son pilares clave para su integración ética y eficaz en el ámbito investigador (15).

En definitiva, la inteligencia artificial —y en especial los modelos de lenguaje como ChatGPT— representan un avance imparable en la investigación, y en concreto en salud. Su potencial es incuestionable, pero su aprovechamiento depende de una combinación equilibrada de entusiasmo, ética y criterio profesional. Con conocimiento, guía y reflexión, los investigadores pueden transformar estas herramientas en auténticas aliadas para una ciencia más ágil, accesible y rigurosa.

Declaración de conflictos de intereses:

El autor reconoce que el texto del artículo no ha sido generado por ChatGPT ni otra herramienta conversacional similar. La edición corrió a cargo del autor.

Tabla 1. Aplicaciones de herramientas de inteligencia artificial por fase del proceso investigador

Tabla 2. Herramientas complementarias basadas en IA para la investigación

Decálogo: Recomendaciones para un uso responsable de la IA en investigación

- Define el propósito antes de usar

- Conoce las limitaciones del modelo

- Prioriza herramientas auditables y fiables

- Respeta la confidencialidad y la protección de datos

- Evita atribuir autoría a la IA

- Declara su uso en publicaciones científicas

- Contrasta con fuentes humanas

- Valora el impacto ético y metodológico

- Fomenta la formación y alfabetización digital

- Evita la dependencia excesiva

Bibliografía

- Conroy G. How ChatGPT and other AI tools could disrupt scientific publishing. Nature. 10 de octubre de 2023;622(7982):234-6.

- Conroy G. Scientific sleuths spot dishonest ChatGPT use in papers. Nature [Internet]. 8 de septiembre de 2023 [citado 10 de octubre de 2023]; Disponible en: https://www.nature.com/articles/d41586-023-02477-w

- Torres-Salinas D. Primeros pasos con ChatGPT e ingeniería de prompts. 22 de abril de 2025 [citado 14 de mayo de 2025]; Disponible en: https://zenodo.org/records/15260567

- Arroyo-Machado W. Análisis de datos, importación y exportación con ChatGPT. 22 de abril de 2025 [citado 14 de mayo de 2025]; Disponible en: https://zenodo.org/records/15260899

- Arroyo-Machado W. Introducción general a ChatGPT. 22 de abril de 2025 [citado 14 de mayo de 2025]; Disponible en: https://zenodo.org/records/15260746

- Else H. Abstracts written by ChatGPT fool scientists. Nature. 19 de enero de 2023;613(7944):423-423.

- Correa FJC, Bautista PS, Ruiz RA, Clavijo ÁC. The Conversation. 2023 [citado 5 de mayo de 2025]. ChatGPT no sueña con ovejas eléctricas. Disponible en: http://theconversation.com/chatgpt-no-suena-con-ovejas-electricas-201061

- X (formerly Twitter) [Internet]. 2023 [citado 14 de mayo de 2025]. ChatGPT Impact Project 🤖 (@chatgptimpact) / X. Disponible en: https://x.com/chatgptimpact

- InfluScience [Internet]. [citado 14 de mayo de 2025]. Inicio. Disponible en: https://influscience.eu/

- Founderz | Imparable eres tú | Escuela de negocios digital [Internet]. [citado 14 de mayo de 2025]. Disponible en: https://founderz.com/es/

- O’Connor S, ChatGPT. Open artificial intelligence platforms in nursing education: Tools for academic progress or abuse? Nurse Educ Pract. enero de 2023;66:103537.

- Coleman KM. Martial: Liber Spectaculorum. OUP Oxford; 2006. 411 p.

- Generative Pre-trained Transformer C, Zhavoronkov A. Rapamycin in the context of Pascal’s Wager: generative pre-trained transformer perspective. Oncoscience. 21 de diciembre de 2022;9:82-4.

- Tools such as ChatGPT threaten transparent science; here are our ground rules for their use. Nature. 24 de enero de 2023;613(7945):612-612.

- COPE: Committee on Publication Ethics [Internet]. 2023 [citado 14 de mayo de 2025]. Authorship and AI tools. Disponible en: https://publicationethics.org/guidance/cope-position/authorship-and-ai-tools

Si te ha gustado este artículo, encontrarás más contenidos interesantes en nuestra sección “ENSEÑANOS TU TRABAJO”.

Y te invitamos a ver nuestros anteriores números de EnRed@2.0.